W świecie, gdzie algorytm generuje nieskończoność wariacji formy, jedynym bastionem twórcy pozostaje intencja. Profesor Krzysztof Meissner ostrzega: oddanie sterów maszynie to nie postęp, lecz regres do czasów przedludzkich.

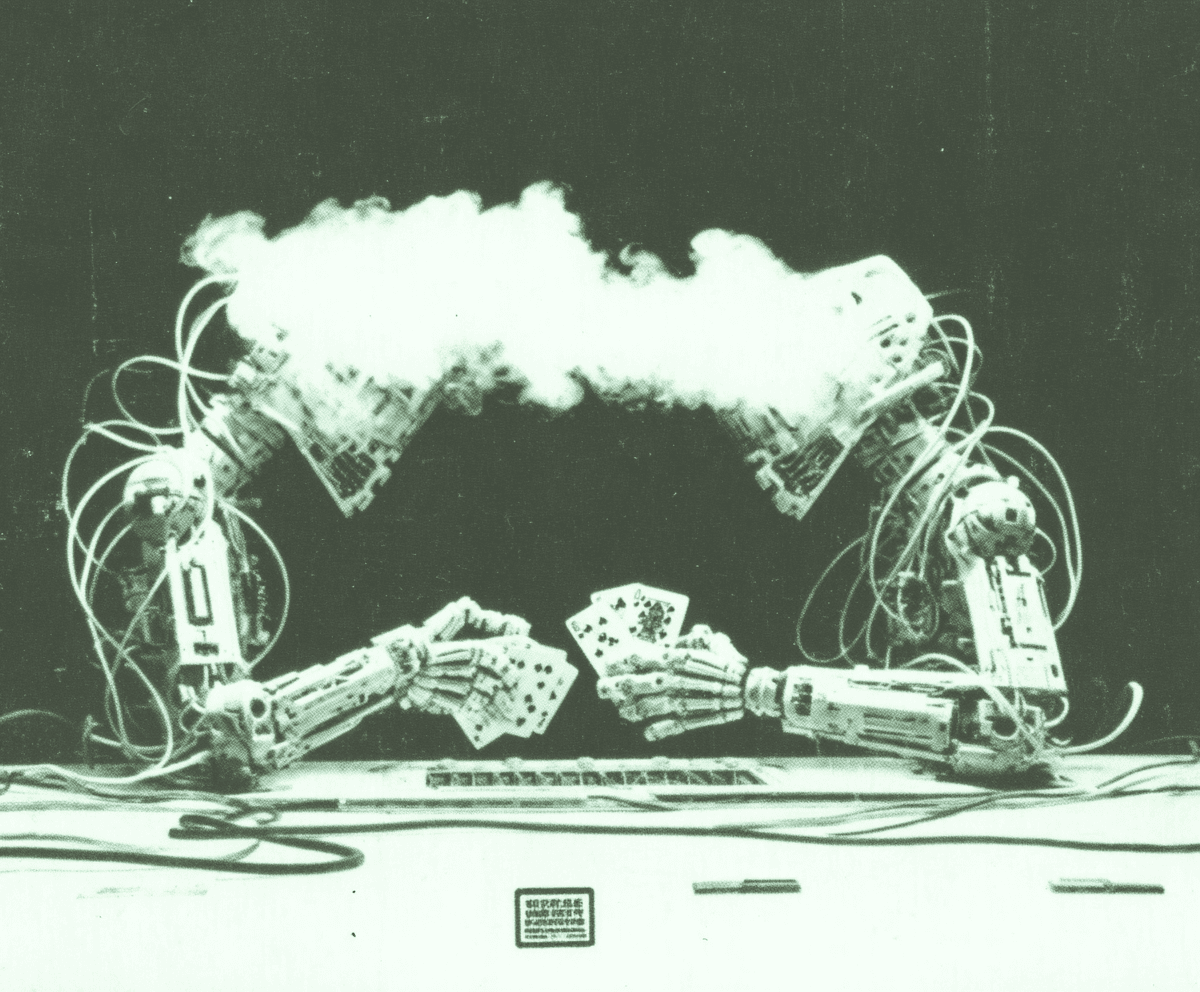

Kiedy w latach 80. Jan Nowicki wcielał się w rolę Wielkiego Szu, oszustwo wymagało zręczności palców i psychologicznej gry. Dziś, jak zauważa prof. Krzysztof Meissner, skrót SI ewoluuje w stronę Sharper Intelligence – inteligencji sprytniejszej, ostrzejszej, ale też: szulerskiej. Dla projektantów, architektów i wizjonerów, to rozróżnienie stanowi nową linię demarkacyjną zawodu.

Pułapka wektora

Istota problemu leży w definicji. Jeśli inteligencją nazwiemy zdolność odnajdywania analogii w wielowymiarowych przestrzeniach wektorowych, maszyna już dawno nas prześcignęła. Systemy generatywne "widzą" korelacje tam, gdzie oko dostrzega jedynie chaos. Jednak Meissner przywołuje łaciński źródłosłów: inteligo – rozumiem.

Tutaj przebiega granica. Algorytm nie rozumie krzesła, które generuje. Przetwarza miliony obrazów, optymalizuje wagę węzłów sieci neuronowej i wypluwa statystycznie poprawny rezultat. Brakuje mu poziomu "meta" – zdolności spojrzenia na własne myślenie z zewnątrz. Projektant bez świadomości staje się jedynie operatorem narzędzia, które doskonale kłamie, nie znając pojęcia prawdy.

Imperatyw nieufności

Wkraczamy w erę ontologicznej niepewności. Meissner stawia diagnozę bezwzględną: domyślny status każdej informacji w sieci to „fałsz”. Obraz i dźwięk, dawne nośniki dowodu, to dziś jedynie tworzywo.

Deep fake to nie tylko trik techniczny, lecz erozja zaufania do zmysłów. Jeśli nie możemy wierzyć oczom, musimy wierzyć procedurom. Sceptycyzm przestaje być postawą intelektualną, a staje się instynktem przetrwania. W starciu z Sharper Intelligence, symulującą rzeczywistość, naszą jedyną bronią pozostaje wątpliwość. Bez niej stajemy się bezwolnym elementem zbioru danych, podatnym na każdą manipulację, którą algorytm uzna za optymalną dla zadanej funkcji celu.

Ontologiczny sufit. Dlaczego algorytm nie dozna olśnienia

Współczesny dyskurs myli generatywność z kreatywnością. To błąd kategorialny. Profesor Meissner, analizując strukturę przełomów naukowych, obnaża fundamentalną słabość maszyn: są one niewolnikami ciągłości.

Sieć neuronowa działa przez analogię. To mechanizm doskonały do interpolacji – wypełniania luk w tym, co znane. Potrafi stworzyć wariację na temat, syntezę stylów, optymalizację formy. Nie potrafi jednak dokonać zerwania.

Meissner przywołuje dowód z historii fizyki. Gdyby na początku XX wieku istniała potężna SI, nakarmiona wiedzą o mechanice klasycznej, jej "twórczość" polegałaby na nieskończonym doskonaleniu równań Newtona. Algorytm nigdy nie sformułowałby Ogólnej Teorii Względności. Einstein nie zoptymalizował Newtona; on go zaprzeczył. Stworzył nowy paradygmat, wynikający z intuicji i iluminacji – zjawisk niedostępnych dla kodu opartego na danych historycznych.

Dla wzornictwa płynie stąd brutalny wniosek: AI to narzędzie doskonałej stagnacji. Pozwoli stworzyć tysiąc wariantów produktu w minutę, ale nie wymyśli nowej kategorii. Prawdziwa innowacja wymaga skoku w nieznane, a nie interpolacji przeszłości.

Kody kulturowe. Kolonizacja nieświadomości

Profesor dotyka tu kwestii suwerenności myślenia. Kod kulturowy to system operacyjny społeczeństwa. Niewidzialna siatka pojęć i wartościowań. Sztuczna inteligencja nie posiada kultury; posiada zbiór danych.

Zagrożenie nie polega na tym, że maszyna nie zrozumie lokalnego kontekstu. Polega na tym, że statystycznie go uśredni. Model karmiony globalnymi korpusami dokonuje cichego nadpisania lokalnych systemów wartości. To nowa forma kolonizacji – kognitywna. Algorytm przemyca etykę utylitarną lub korporacyjną efektywność w miejsca, gdzie dotąd rządziły inne paradygmaty.

Projektant korzystający z tych narzędzi staje się nieświadomym przemytnikiem. Wprowadza do obiegu przedmioty i komunikaty, które tylko pozornie rezonują z odbiorcą, a w istocie formatują go pod wymogi algorytmu. To inżynieria społeczna na poziomie mikrosekund. Oddanie maszynie władzy nad sferą symboliczną to zgoda na spłaszczenie świata i redukcję kultury do estetycznej tapety.

Lenistwo jako zagrożenie

Ryzyko nie tkwi w buncie maszyn, lecz w abdykacji człowieka. Meissner wskazuje na "umysłowe lenistwo" jako powód oddawania władzy decyzyjnej. Wygoda automatyzacji usypia. Projektant, który przestaje pytać "dlaczego?", a zadowala się odpowiedzią na "jak?", traci podmiotowość.

Stajemy w obliczu manipulacji na niespotykaną skalę. Skoro algorytm może profilować emocje odbiorcy skuteczniej niż on sam je rozumie, projektowanie przestaje być służbą. Wprowadzenie "obcych kodów" do intymnej sfery życia użytkownika odbywa się bezszelestnie, pod płaszczykiem personalizacji.

Ostatni bastion: Meta-świadomość

Co pozostaje człowiekowi? Samoświadomość. Zdolność do zadania pytania o sens. Fizyka i matematyka opisują świat, ale go nie czują. Meissner konkluduje: jeżeli oddamy maszynom sferę decyzji i wartościowania, cofniemy się w rozwoju.

W dobie generatywnej nadprodukcji rola projektanta przesuwa się z twórcy formy na kustosza sensu. To my musimy weryfikować "halucynacje" systemu, odróżniać prawdę od statystycznego prawdopodobieństwa i stawiać opór wygodnej dyktaturze Sharper Intelligence.

Wielki Szu rozdaje karty szybciej niż kiedykolwiek. Sztuka polega na tym, by nie grać w jego grę, lecz zmienić zasady stołu.

Opracowano na podstawie wykładu prof. Krzysztofa A. Meissnera: "Sztuczna Inteligencja Wielka SI".